Schwimmweste für die Datenflut an 2 400 000 000 000 000 000 000 Bits

Information ist die Währung der Wissensgesellschaft - und ihre Menge wächst, in der Nationalbibliothek um | 14,5 Terabyte pro Jahr. Die globale Datenmenge schafft Probleme, denn die Mehrheit davon ist unstrukturiert.

Fragen nach Qualität und Nützlichkeit einmal hintangestellt, wächst das Wissen der Menschheit mit jedem Tag. Die amerikanischen Wissenschaftler Martin Hilbert and Priscila López haben sich dem Phänomen wertfrei genähert und in Zahlen gefasst, über wie viele Daten die Menschheit verfügt. Sie veröffentlichten ihre Ergebnisse unlängst im Fachblatt "Science“. Dabei haben sie 60 analoge und digitale Technologien vom Plattenspieler bis zum iPhone einbezogen und einen Zeitraum von 1986 bis 2007 gewählt. Zur besseren Vergleichbarkeit haben die Forscher die Datenmenge "normalisiert“, also umgerechnet, wie viel Platz diese bei optimaler Kompression einnehmen würden (faktisch sind es also viel mehr). Ausgedrückt in Bits, also der kleinsten informationstragenden Einheit, gab es demnach 2007 knapp 2,4 Zettabits (eine Zahl mit 20 Nullen).

Auf übliche CD-ROMs gespeichert würden diese einen Turm ergeben, der eineinviertel Mal der Strecke zwischen Erde und Mond entspricht. 94 Prozent der Daten liegen in digitaler Form vor, 1986 waren es 0,8 Prozent. Die durchschnittliche jährliche Wachstumsrate beträgt 23 Prozent, nimmt aber zu. Die Analysten des Marktforschers IDC rechnen ein wenig anders und prognostizieren sogar eine Verdopplung des Datenvolumens alle 18 Monate.

Suchmethode wie das Gehirn

"Die Datenflut ist eine der größten Herausforderungen für die Informatik“, bestätigt Josef Küng vom Institut für Anwendungsorientierte Wissensverarbeitung der Johannes Kepler Universität in Linz. "Das Problem ist, dass 80 Prozent aller Daten in unstrukturierter Form vorliegen.“ Sie sind also nicht systematisch in Datenbanken oder Tabellen abgelegt, sondern tummeln sich in Form von Videos, Blogs oder gespeicherten E-Mails auf den Servern dieser Welt. Wie Küng arbeiten viele Wissenschaftler an neuen Methoden, um gezielt Informationen aus dem Datenmoloch zu extrahieren. Dem sind Grenzen gesetzt. Ein Beispiel: In einem Kurzvideo ist der Siegestreffer eines Fußballspiels zu sehen. Will man nun wissen, ob der glückliche Schütze mit dem Innen- oder dem Außenrist geschossen hat, hilft keine Software weiter. Man muss sich das Video ansehen. "Ideal wäre es, Methoden zu haben, die Informationen ähnlich wie unser Hirn verarbeiten“, sagt Küng. Davon ist die Forschung noch ein Stück weit entfernt.

Der rasante Zuwachs an Daten verursacht nicht allen Kopfzerbrechen. Für die Sozialwissenschaften bietet er eine willkommene Möglichkeit ihre Theorien empirisch zu untermauern. Welche, je nach Betrachtungsweise, faszinierenden oder beängstigenden Resultate das ergibt, demonstrieren beispielsweise Forscher des SENSEable City Laboratory am MIT.

Anhand der (anonymen) Verbindungsdaten von Mobiltelefonen erstellen sie grafische Landkarten, auf denen die Bewegungen von Menschenmassen durch eine Stadt nachvollziehbar sind. Aus den dabei vorhandenen statistischen Regelmäßigkeiten lassen sich die Bewegungen großer Gruppen mit hoher Zuverlässigkeit voraussagen. Diese Informationen könnten Einsatzkräften bei Großveranstaltungen helfen, Massenpaniken zu verhindern. In einem anderen Projekt haben die MIT-Forscher Fotos ausgewertet, die in Spanien gemacht und anschließend auf die Fotoplattform Flickr hochgeladen wurden. Aus den Herkunftsländern der Fotografen und den auf den Fotos abgebildeten Motiven lässt sich gut ablesen, welche Landsleute welche Gegenden und Sehenswürdigkeiten bevorzugen. Daraus können Tourismusunternehmen maßgeschneiderte Reiseangebote erstellen.

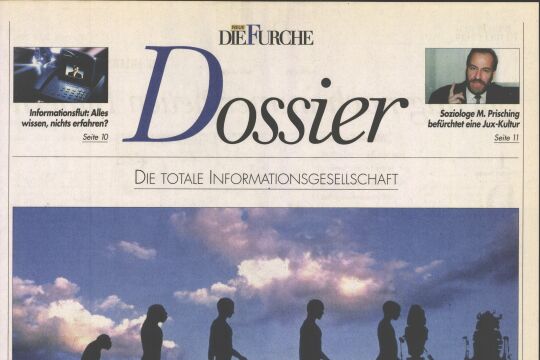

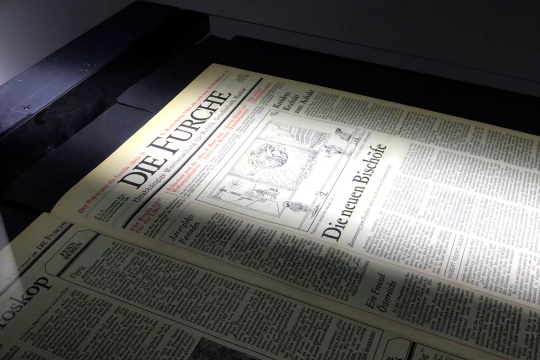

Trotz Digitalisierung: Die Lesesäle der NB sind voll

Auch im Zeitalter der digitalen Masseninformation haben die klassischen Bibliotheken als Orte der kontemplativen Ruhe und des Wissens längst nicht ausgedient. Die Nationalbibliothek beispielsweise sammelt nicht nur jedes neue Druckwerk, sondern digitalisiert auch Bücher und Zeitungen und speichert zudem jede Website mit österreichischer Domain. "Unsere digitalen Bestände wachsen pro Jahr um 14,5 Terabyte“, sagt ÖNB-Generaldirektorin Johanna Rachinger. "Gleichzeitig sind die Lesesäle voll.“ Als nationales Gedächtnis muss die Nationalbibliothek mit der Zeit gehen. Besonderes Augenmerk liegt deshalb auf der sachgemäßen Aufbereitung der Informationen. Dazu leistet auch die besonders nutzerfreundliche neue Suchmaschine des Österreichischen Bibliothekenverbundes ihren Beitrag, die seit vergangener Woche online ist. Sie umfasst mehr als acht Millionen Werke in 80 Bibliotheken. Für digitalisierte Bestände ist zudem eine Volltextsuche möglich. "Irgendwann werden so gut wie alle Wissensbestände in digitaler Form vorliegen“, sagt Generaldirektorin Rachinger. "Man muss sie aber auch finden können. Denn was im Netz nicht mehr auffindbar ist, wird irgendwann aus dem Denken der Menschen verschwinden.“

Ein Thema. Viele Standpunkte. Im FURCHE-Navigator weiterlesen.

In Kürze startet hier der FURCHE-Navigator.

Steigen Sie ein in die Diskurse der Vergangenheit und entdecken Sie das Wesentliche für die Gegenwart. Zu jedem Artikel finden Sie weitere Beiträge, die den Blickwinkel inhaltlich erweitern und historisch vertiefen. Dafür digitalisieren wir die FURCHE zurück bis zum Gründungsjahr 1945 - wir beginnen mit dem gesamten Content der letzten 20 Jahre Entdecken Sie hier in Kürze Texte von FURCHE-Autorinnen und -Autoren wie Friedrich Heer, Thomas Bernhard, Hilde Spiel, Kardinal König, Hubert Feichtlbauer, Elfriede Jelinek oder Josef Hader!