"Vor Deep-Fakes habe ich Angst"

Wie sehr Social Bots die EU-Wahlen beeinflusst haben, wird man erst sehen. Dass künstliche Intelligenz ethische Richtlinien braucht, ist für die in Cambridge forschende Wienerin Charlotte Stix aber gewiss.

Wie sehr Social Bots die EU-Wahlen beeinflusst haben, wird man erst sehen. Dass künstliche Intelligenz ethische Richtlinien braucht, ist für die in Cambridge forschende Wienerin Charlotte Stix aber gewiss.

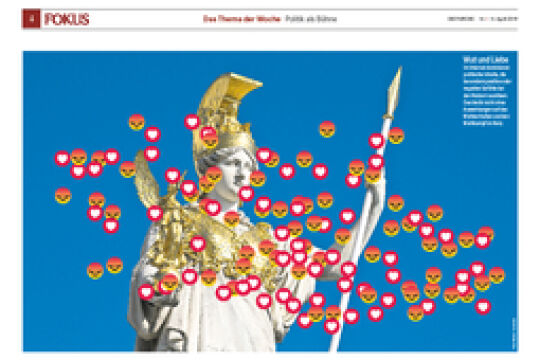

Die Wahlen sind geschlagen – und das befürchtete Abdriften ganz Europas in die fins-tere Welt des Steve Bannon ist ausgeblieben. Viel war im Vorfeld davon die Rede gewesen, mit welchen Tricks Russland in den EU-Wahlkampf eingreifen könnte und wie man automatisierte Computerprogramme – so genannte Social Bots, die in sozialen Medien wie echte Nutzer agieren und Botschaften verbreiten – bekämpfen kann.

Um großangelegte Desinformationskampagnen wie vor dem Brexit-Referendum oder dem US-Wahlkampf 2016 zu verhindern, haben sich EU-Cyber-Spezialisten vor der Wahl mit einer NATO-Expertengruppe beraten. Wie erfolgreich sie waren, ist noch nicht abschätzbar.

Demokratie, Autonomie, Freiheit: Um nichts weniger geht es hier, weiß Charlotte Stix. Die junge Wienerin forscht als Policy Officer am „Leverhulme Centre for the Future of Intelligence“ an der Universität Cambridge zur Ethik Künstlicher Intelligenzsysteme. Und sie ist als Vordenkerin in der ganzen Welt gefragt: gestern in Mexico City, heute in San Francisco, am 4. Juni in Graz, um im Rahmen der Reihe „Styria Ethics“ vor Studierenden der FH Joanneum über „Mensch-Maschine-Medien-Moral“ zu referieren – und tags darauf beim Pfingstdialog in Leibnitz. Auch wenn bei den EU-Wahlen das Schlimmste abgewehrt werden konnte: „Dass im Internet immer auch Bots mitmischen – dessen ist sich hoffentlich jeder bewusst“, meint Stix im Skype-Interview. Zwei bis vier Prozent: Schon so wenige Bots reichen laut einer Studie der Uni Duisburg-Essen aus, um andersmeinende Nutzer in kontroversen Diskussionen zum Schweigen zu bringen.

Wie klug ist KI wirklich?

Mit „Intelligenz“ im klassisch-menschlichen Sinn haben Algorithmen aber wenig zu tun, betont die Forscherin, die Ethik, Philosophie und Kognitive Wissenschaften studiert hat und vom Weltwirtschaftsforum zum „Young Global Shaper“ gekürt wurde. Überhaupt plädiert Stix dafür, den Hype um „künstliche Intelligenz“ zu relativieren: „Es geht hier einfach um Systeme, die aus vielen Daten auf ein spezifisches und sehr kleines Domänenproblem trainiert werden“, meint sie. Aber dieses „Erlernte“ auf andere Domänen zu transferieren – und sei es nur von einem Antari-Computerspiel auf das nächste –, würde Algorithmen intellektuell überfordern.

Wie kann es dann aber sein, dass sie sogar „kreativ“ werden? Tatsächlich hat die Non-Profit-Organisation „OpenAI“ vor Kurzem mit „MuseNet“ ein Programm präsentiert, das offenbar Musikstücke und Arien komponieren kann. „Ist das kreativ im dem Sinne, dass Neues erschaffen wird? Ja“, sagt Stix. „Aber ist es die Art von Kreativität, die wir auch Menschen zuschreiben? Hier wird es fraglich.

Es ist leicht, das Gesicht einer Frau – etwa einer Politikerin – auf dem Körper einer Pornodarstellerin zu transferieren und auch Stimmen zu manipulieren.

Auch im Journalismus ist immer mehr Künstliche Intelligenz „kreativ“ im Einsatz: Systeme sind mittlerweile in der Lage, Texte zu produzieren, die sich je nach Bedarf eher nach Fantasiegeschichte oder Kochbucheintrag anhören. Die Austria Presse Agentur arbeitet schon mit automatisierten Berichten über Fußballergebnisse. „KI kann helfen und die Arbeit von Journalisten vereinfachen“, meint Stix. „Problematisch wird es dort, wo sie losgelassen wird und irgendwelche Geschichten erzählt, die nicht nachvollziehbar sind.“

Womit wir wieder bei den „Social Bots“ vom Anfang wären – also Algorithmen, die Texte zusammenstellen und im Internet posten. „Diese Bots, die Menschen und Wähler mit Fake News in eine Richtung treiben können, sind ein Risiko“, sagt Charlotte Stix. Aber ein noch größeres Risiko ist aus ihrer Sicht die Option, nicht nur Texte, sondern auch Videos und Stimmen zu manipulieren. „Deep-Fakes“ nennt sich das, totale Fälschungen. „Es ist leicht, das Gesicht einer Frau, etwa einer Politikerin, auf den Körper einer Pornodarstellerin zu transferieren und auch Stimmen zu manipulieren. Vor diesen Deep-Fakes habe ich wirklich Angst“, sagt Stix. Natürlich könnten Forensiker diese Fakes später ausforschen. Doch angesichts der Schnelligkeit der digitalen Welt könne bis dahin viel passieren.

So nützlich Künstliche Intelligenz zweifellos ist – so riskant kann sie sein. Nehmen wir etwa das automatisierte Fahren. Das „Trolley-Problem“, also die Frage, welches Hindernis ein selbstfahrendes Auto im Zweifel niederfahren soll (eine Frau mit Kinderwagen? einen alten Mann?) gilt als klassisches ethisches Dilemma (vgl. S. 5 und 6). Doch Stix fällt noch ein anderes Beispiel ein, das mit Bilderkennung zu tun hat. „Man könnte ein klitzekleines Pixel auf ein Stoppschild kleben, das dem System nicht mehr sagt ,Ich bin ein Stoppschild!‘, sondern ,Ich bin ein Schild, das dir sagt, dass du jetzt sehr schnell fahren musst.‘ Das sind banale Dinge, angesichts derer etwas dramatisch schiefgehen kann.“

Neuer Befehlston à la Alexa

Zudem muss man Algorithmen alle Eventualitäten einprogrammieren, mit denen Menschen ganz selbstverständlich umgehen können. Dass man beim Staubsaugen weder herumliegende Eheringe noch Katzenschwänze aufsaugen soll, ist für jedes Humanum plausibel; für den automatisierten Staubsauber „Roomba“ hingegen nicht.

Nicht zuletzt kann Künstliche Intelligenz auch das Miteinander prägen. „Sie kann die sozialen Grenzen verändern“, weiß Stix. „Ob auf Tinder oder in der Politik – man trifft dann nur noch auf Leute oder Themen, die zum eigenen Profil passen.“ Auch die Art des Umgangs könnte anders werden, etwa durch digitale Assistenten wie Alexa von Amazon, von denen weltweit bereits über 100 Millionen Stück verkauft wurden. „Kinder lernen heute durch Alexa, dass es reicht, wenn man einen Frauennamen schreit und etwas befiehlt“, so Stix. Am Ende könnte es nicht zuletzt dazu kommen, dass das System mehr über uns weiß, als wir selbst. Man denke etwa an Programme, die anhand der Stimmfärbung feststellen können, ob man auf eine mentale Krise zusteuert – oder anhand des unbewussten Einkaufsverhaltens erkennen, ob man womöglich schwanger ist.

Ethikrichtlinien made in Europe

All das zeigt, dass es für den Einsatz Künstlicher Intelligenz dringend ethische Richtlinien braucht. Und Europa will hier Vorreiter sein: Vergangenen April hat die Europäische Kommission mit ihren „Ethik-Leitlinien für eine vertrauenswürdige Künstliche Intelligenz“ neue Standards gesetzt. Die Basis liefert die Datenschutzgrundverordnung, darüber hinaus geht es um technische Sicherheit, Transparenz, Diversität oder Umweltverträglichkeit. „Künstliche Intelligenz ist ja toll, aber sie braucht extrem viel Energie. Die Frage ist also, wie etwas, das unsere Welt besser machen soll, sie nicht gleichzeitig schlechter macht“, sagt Stix. Um den Konsumenten größtmögliche Sicherheit zu geben, wird bis 2020 mit Industriepartnern eine Checkliste erarbeitet, anhand derer ein Zertifikat für eine vertrauenswürdige Künstliche Intelligenz made in Europe entwickelt werden soll. Ob sich auch China daran orientieren wird? „Man kann die höheren ethischen KI-Standards natürlich nicht einfach exportieren“, sagt Charlotte Stix. „Aber man kann sicherstellen, dass alle Organisationen, die in Europa tätig sind, dementsprechend agieren. Und der, der die Regeln zuerst vorgibt, setzt auch später meist die Standards für alle.“

Stix selbst ist zuversichtlich, dass das gelingen wird. Fehlt nur noch ausreichend KI-Kompetenz in Europa. In ihrer Wahlheimat Großbritannien hat man zuletzt 1000 einschlägige Doktorate gesponsert. Österreich bäckt hier kleinere Brötchen: Die ehemalige Wirtschaftsministerin Margarete Schramböck (ÖVP) hat vorgeschlagen, einen „Lehrberuf Künstliche Intelligenz“ zu lancieren. „Die Idee ist nicht falsch, weil es gut wäre, wenn mehr Leute mit KI und Robotik umgehen könnten“, meint Charlotte Stix. „Aber man braucht auch mehr Leute, die diese technologischen Umbrüche auch wirklich mitgestalten können.“