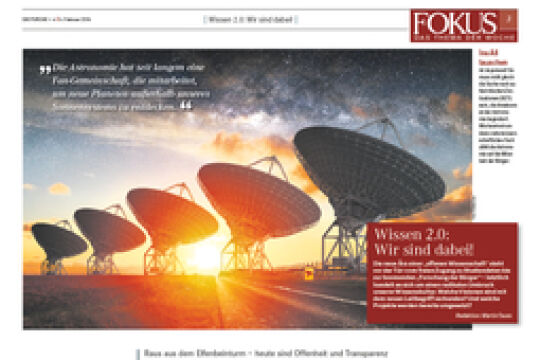

IT-Experte Roman Kern über rechtliche Grenzen für Künstliche Intelligenz

Die Europäische Union will den Gefahren der Künstlichen Intelligenz mit rechtlichen Tatsachen begegnen. KI-Experte Roman Kern über fehlerhafte Chatbots, voreingenommene Daten und den schmalen Grat zwischen Innovation und Regulierung.

Die Europäische Union will den Gefahren der Künstlichen Intelligenz mit rechtlichen Tatsachen begegnen. KI-Experte Roman Kern über fehlerhafte Chatbots, voreingenommene Daten und den schmalen Grat zwischen Innovation und Regulierung.

Um eine vertrauenswürdige Künstliche Intelligenz zu entwickeln, arbeitet die EU an einem gesetzlichen Regulierungswerk. Ende April haben sich die Abgeordneten des EU-Parlaments auf einen Entwurf geeinigt. Der sogenannte AI-Act soll 2025 in Kraft treten. Die FURCHE sprach dazu mit Roman Kern, Assistenzprofessor an der TU Graz und Leiter der Abteilung „Knowledge Discovery“ am Know-Center Graz, einem Forschungszentrum für datenbasierte Wirtschaft und KI.

DIE FURCHE: In einer Stellungnahme zum AI-Act kritisieren zahlreiche Forscher, darunter der an der Uni Wien forschende Technikphilosoph Mark Coeckelbergh, dass das Regelwerk zu spät komme. Teilen Sie diese Meinung?

Roman Kern: Dem würde ich zustimmen: Wenn Nutzer sich erst an den Komfort von unregulierten KI-Systemen gewöhnt haben, dann ist es rechtlich sehr schwer, dort noch einzugreifen. Menschen irgendetwas wegzunehmen, ist generell das Schlimmste, was man machen kann. Ob die Politik so ein Risiko eingeht, bleibt die große Frage. Ein weiteres Thema beim AI-Act ist, ob die Rolle von Chatbots kritischer gesehen werden sollte.

DIE FURCHE: Diese werden im AI-Act als geringes Risiko eingestuft. Welche Gefahren sehen Sie in den Chatbots?

Kern: Chatbots können schnell viel Text produzieren. Dadurch kann auch rasch viel Fehlinformation entstehen. Generative KI kombiniert bestehende Informationen oder Wissen auf neue Art und Weise. Es entsteht zwar Neues, das plausibel scheint, aber nicht notwendigerweise logisch ist. Da können auch physikalische Gesetze gebrochen werden: So kann es etwa schnell einmal unter Wasser brennen. Wir sprechen dann vom „Halluzinieren“.

DIE FURCHE: Die AI-Act-Arbeitsgruppe, die zwölf Gesetzgeber der EU vertritt, hat vor Kurzem in einem offenen Brief ihre Bedenken geäußert, da die KI-Entwicklung momentan zu rasant voranschreite. Unter anderem forderte sie einen globalen KI-Gipfel. Wäre es sinnvoll für Europa, andere Staaten mit ins Boot zu holen?

Kern: Absolut. Ich habe immer diese technologische Brille auf – ich sehe, wie generative KI trainiert wird. Das geschieht mit Daten, die potenziell einen „Bias“ haben, also voreingenommen sind. Sie repräsentieren nicht die gesamte Menschheit, sondern sehr stark die westliche Welt. Da reden wir von „Bias in, Bias out“ – verwende ich voreingenommene Daten, so zeigt sich das auch im Ergebnis. Es wäre sinnvoll, andere Sichtweisen einzubeziehen.

DIE FURCHE: … und ein gemeinsames Regelwerk zu verfassen?

Kern: Ja, das ist ein globales Problem. Es scheint, als würden wir eine globale Lösung brauchen. Aber ich bin da vielleicht etwas naiv.

Ein Thema. Viele Standpunkte. Im FURCHE-Navigator weiterlesen.

In Kürze startet hier der FURCHE-Navigator.

Steigen Sie ein in die Diskurse der Vergangenheit und entdecken Sie das Wesentliche für die Gegenwart. Zu jedem Artikel finden Sie weitere Beiträge, die den Blickwinkel inhaltlich erweitern und historisch vertiefen. Dafür digitalisieren wir die FURCHE zurück bis zum Gründungsjahr 1945 - wir beginnen mit dem gesamten Content der letzten 20 Jahre Entdecken Sie hier in Kürze Texte von FURCHE-Autorinnen und -Autoren wie Friedrich Heer, Thomas Bernhard, Hilde Spiel, Kardinal König, Hubert Feichtlbauer, Elfriede Jelinek oder Josef Hader!