Politik zum Einloggen

FOKUS

Könnte Künstliche Intelligenz die US-Präsidentschaftswahlen manipulieren?

Künstliche Intelligenz dürfte bei der kommenden US-Präsidentschaftswahl eine wichtige Rolle spielen. Mit sogenannten Deep Fakes lässt sich Gewalt schüren und die öffentliche Meinung manipulieren. Gewinnt letztlich jene Partei, die die bessere Software besitzt?

Künstliche Intelligenz dürfte bei der kommenden US-Präsidentschaftswahl eine wichtige Rolle spielen. Mit sogenannten Deep Fakes lässt sich Gewalt schüren und die öffentliche Meinung manipulieren. Gewinnt letztlich jene Partei, die die bessere Software besitzt?

Vor wenigen Monaten ging im Netz ein Foto viral, das Papst Franziskus in einem weißen Daunenmantel zeigt. Doch das Bild, das in den Medien rauf- und runterlief, war ein Fake – erstellt wurde es von einem Bauarbeiter aus Chicago mit einem Bildgenerator.

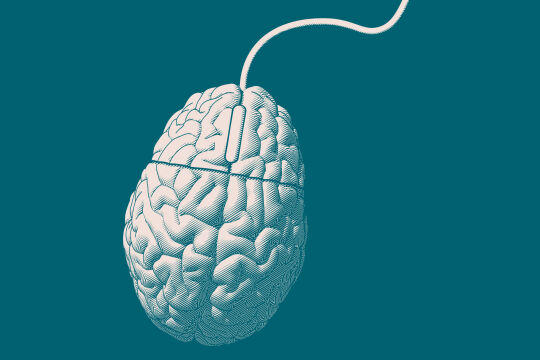

Mit Künstlicher Intelligenz(KI) kann heute jeder Bilder nach seinen Wunschvorstellungen kreieren. Man muss nur eine Bildbeschreibung, einen sogenannten Prompt, eingeben, Sekunden später spuckt die KI ein Foto aus. Angela Merkel und Barack Obama gemeinsam laufend am Strand, Donald Trump in Häftlingskleidung, Emmanuel Macron als Müllwerker – per Mausklick lassen sich Fake-Aufnahmen erstellen, die verblüffend echt aussehen. Photoshop war gestern, KI ist heute. Es braucht noch nicht mal einen Fotoapparat oder ein Motiv vor der Linse. Früher waren solche Spezialeffekte allenfalls in teuren Hollywoodstudios realisierbar. Heute gibt es frei zugängliche Bildgeneratoren im Internet.

Mit solchen Tools lassen sich im Handumdrehen Stimmen klonen oder Gesichter auf Körper montieren, die sich in Bewegtbildern wie Sprechpuppen steuern lassen. Im vergangenen Jahr kursierte im Internet ein gefälschtes Video, in dem dem ukrainischen Präsidenten Wolodymyr Selenskyj eine Kapitulationserklärung in den Mund gelegt wurde. Man braucht dafür keine Sprach- oder IT-Kenntnisse, sondern nur etwas Geschick im Umgang mit Software. KI hat die Verbreitung von Desinformationen niedrigschwelliger gemacht. Mit Blick auf den anstehenden US-Präsidentschaftswahlkampf wächst daher die Sorge, dass mit solchen Deep Fakes die öffentliche Meinung manipuliert werden könnte.

Von der Spielerei zur Gefahr

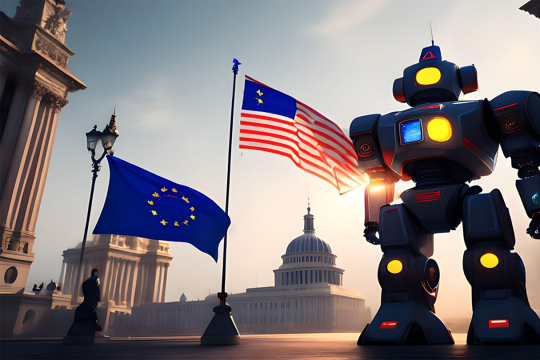

Dabei sind es längst nicht nur russische Hacker, die sich der Technik bedienen. Auch Politiker in demokratischen Ländern verstehen sich immer besser auf das digitale Fälscherhandwerk. So hat in Neuseeland die rechtspopulistische National Party mithilfe von KI in sozialen Medien Bilder von Ladendiebstählen verbreitet, um sich im Politikfeld der inneren Sicherheit zu profilieren. Auch die AfD hat bereits KI-generierte Wahlplakate ins Netz gestellt, um Stimmung gegen Flüchtlinge zu machen. Und die Republikanische Partei in den USA hat sogar ein Wahlkampfvideo im Internet veröffentlicht, in dem das dystopische Bild eines Landes im Bürgerkrieg gezeichnet wird. Was als Spielerei am Computer begann, könnte sich zu einer Gefahr für die Demokratie auswachsen.

Die Internetpioniere träumten einst von einer elektronischen Agora, in der jeder gleichberechtigt seine Meinung artikulieren kann. Allein, von dieser Utopie ist nicht viel übriggebelieben. Autoritäre Regime zensieren das Netz und koppeln sich vom World Wide Web ab (China, Iran, Russland), Trollfabriken fluten das Netz mit Hass und Fake News, und eine Handvoll amerikanischer und chinesischer Konzerne kontrolliert mit ihren Black-Box-Algorithmen die Informationsströme und betreibt ein klandestines Agendasetting.

Bolivien als Versuchslabor

Facebook hat vor einigen Jahren in Ländern wie Bolivien und Kambodscha im Livebetrieb Experimente an seinem NewsfeedAlgorithmus durchgeführt und damit ganze Demokratien zu Versuchslaboren gemacht. Galt Facebook einst als Revolutionshelfer des Arabischen Frühlings („Facebook-Revolution“), steht die Plattform heute im Verdacht, mit ihren Algorithmen Wahlen zu manipulieren und Gewalt zu schüren.

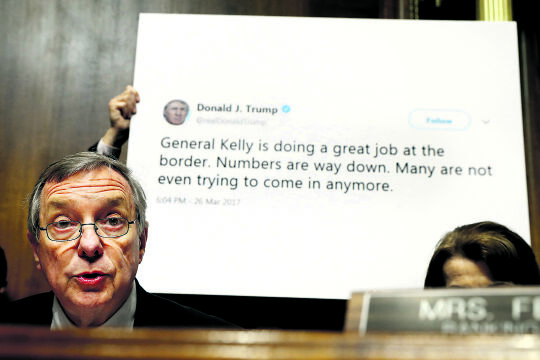

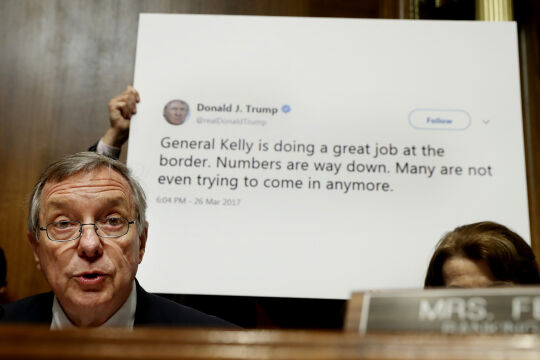

Der Mutterkonzern Meta musste im vergangenen Jahr wegen des Datenskandals um Cambridge Analytica 725 Millionen Dollar Strafe zahlen. Die dubiose Datenfirma, die enge Beziehungen zum Trump-Berater Steve Bannon pflegte, hatte über einen App-Entwickler Zugang zu 87 Millionen Facebook-Konten erlangt, denen personalisierte Werbung ausgespielt wurde. Ohne Facebook wäre Donald Trump wohl nicht US-Präsident geworden, wäre Großbritannien heute noch in der EU. Mit Künstlicher Intelligenz könnte das sogenannte Microtargeting, also die zielgenaue Wähleransprache, auf das nächste Level gehoben werden.

Big-Data-Wahlkämpfe funktionierten bislang so, dass man Wähler in bestimmte Kategorien (Einkommen, Hobbys, Wohnort) einteilte und aus Präferenzen (etwa Likes in Social Media) Persönlichkeitsprofile erstellte. So verriet der Whistleblower Christopher Wylie, Ex-Mitarbeiter von Cambridge Analytica, dass bei der Identifizierung potenzieller Trump-Wähler der Mode- und der Musikgeschmack eine wichtige Rolle gespielt hätten. Facebook-Fans von Modelabels wie Denim oder Wrangler waren offenbar besonders empfänglich für populistische Botschaften. Diese Anzeigen kamen aber selbst von der Stange und waren auf einen bestimmten „Durchschnittsverbraucher“ zugeschnitten. Mithilfe von Sprachmodellen lassen sich Botschaften noch stärker individualisieren und emotionalisieren.

Ein Thema. Viele Standpunkte. Im FURCHE-Navigator weiterlesen.

In Kürze startet hier der FURCHE-Navigator.

Steigen Sie ein in die Diskurse der Vergangenheit und entdecken Sie das Wesentliche für die Gegenwart. Zu jedem Artikel finden Sie weitere Beiträge, die den Blickwinkel inhaltlich erweitern und historisch vertiefen. Dafür digitalisieren wir die FURCHE zurück bis zum Gründungsjahr 1945 - wir beginnen mit dem gesamten Content der letzten 20 Jahre Entdecken Sie hier in Kürze Texte von FURCHE-Autorinnen und -Autoren wie Friedrich Heer, Thomas Bernhard, Hilde Spiel, Kardinal König, Hubert Feichtlbauer, Elfriede Jelinek oder Josef Hader!