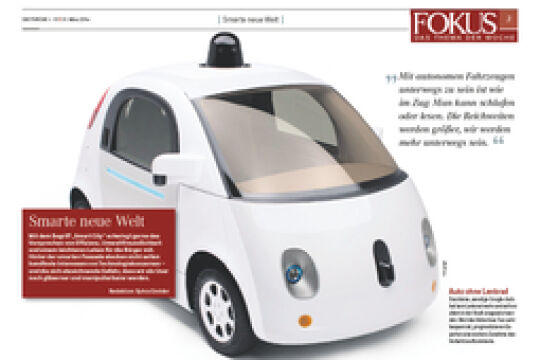

Autonome Systeme übernehmen im Alltag und im Verkehr Steuerungen. Ihr Einsatz löst völlig neue juristische und ethische Fragen aus.

Rechtswissenschaftler Eric Hilgendorf (r.), Leiter der Forschungsstelle RobotRecht an der Universität Würzburg, über juristische Herausforderung moderner Robotertechnik.

Die Furche: Was darf man sich unter den jungen Begriffen Roboterrecht und Roboterethik vorstellen?

Eric Hilgendorf: Ich bevorzuge den Begriff "Autonome Systeme“. Wir beschäftigen uns mit den Rechtsfragen autonomer Systeme. Roboter assoziiert man mit humanoiden Gestalten, die im schlimmsten Fall zu rebellieren beginnen und wie der Terminator Menschen angreifen. Was uns interessiert, sind automatische Einparkhilfen im Auto oder automatisierte Operationssysteme. Also Maschinen, die in dem Sinn autonom sind, dass sie über längere Zeit hinweg ohne menschliche Einflussnahme arbeiten können. Und hier stellen sich Fragen wie: Wer haftet im Schadensfall? Wie sieht es mit dem Datenschutz aus? Wie bekommt man eine Zulassung für so eine Maschine?

Die Furche: Was ändert sich dadurch für die juristische Praxis?

Hilgendorf: Ein einfaches Beispiel: Automatische Einparkhilfen sind bereits millionenfach im Einsatz. Angenommen, so ein System versagt und man kollidiert beim Einparken mit einem anderen Fahrzeug - wer haftet dann? Hier käme in Betracht, den Hersteller des Systems haften zu lassen. Um das zu vermeiden, ist es in Europa gängige Praxis, dem Fahrer die letzte Entscheidung zu überlassen, indem er die Möglichkeit hat, das System abzuschalten. In den USA wird bereits an fahrerlosen Autos geforscht. Und bei solchen Fahrzeugen wäre dann ein Rückgriff auf die Hersteller möglich. Die möchten das aber natürlich nicht.

Die Furche: Je autonomer ein System ist, desto leichter kann der Hersteller im Schadensfall zur Verantwortung gezogen werden?

Hilgendorf: Genau. Und dieses Problem stellt sich analog bei allen autonomen Systemen. Allerdings ist nicht bei allen diese Letztentscheidung des Nutzers vorgesehen und kann auch oft gar nicht umgesetzt werden. Denken Sie an ein System, das sämtliche Vorgänge in einem Operationssaal vernetzt überwacht - die Einstellung des Tisches, die Körperfunktionen des Patienten und so weiter. Hier ist die Frage nach der Letztentscheidung von Menschen sinnlos. Denn während der Operation muss einfach alles funktionieren. Da kann man nicht einen Menschen fragen, ob das System alles richtig macht. Was an dieser Situation aus juristischer Sicht aber auffällt, ist das Problem des Datenschutzes. Hier werden medizinische Daten erhoben und solche dürfen nicht an Dritte weitergegeben werden. Man muss also vom Hersteller des Systems fordern, dass Daten so abgespeichert werden, dass nur der Arzt und sein Team darauf zugreifen können. Das scheint im Prinzip klar, aber Techniker sehen solche Probleme oft gar nicht.

Die Furche: Das hört sich an, als wäre Ihr Interesse von Firmen getrieben, die Klagen fürchten.

Hilgendorf: Es gibt beide Motivationen. Das Forschungsfeld eröffnet eine Vielzahl an Fragen. Manche sind konkret, manche abstrakter. Manche sind schon heute relevant, manche erst in der Zukunft. Die Probleme, die ich mit Einparkhilfe und Operationssaal angesprochen habe, stellen sich bereits auf einer sehr geringen Abstraktionsebene. Man kann sich aber auch Gedanken über Probleme in der Zukunft machen, etwa über Rechte für Maschinen. Als Jurist halte ich das für ein Science-Fiction-Thema. Aber als Rechtsphilosoph finde ich es interessant, darüber nachzudenken, ab welchem Grad von Autonomie, Intelligenz oder sogar Einfühlsamkeit man Maschinen eines Tages eventuell irgendwelche Rechte zubilligen kann, beispielsweise Grundrechte.

Die Furche: Wer so etwas fordert, wird wohl mit empörtem Widerspruch rechnen müssen.

Hilgendorf: Zum heutigen Zeitpunkt wahrscheinlich. Andererseits gibt es hier Parallelen zur Tierethik. Derzeit sind die besten autonomen Systeme etwas leistungsstärker als Insekten, aber noch lange nicht so leistungsstark wie Säugetiere. Die Techniker sagen uns, dass die Entwicklung schnell vorangeht und ihre Systeme schon in wenigen Jahren das Niveau von einfachen Säugetieren wie Ratten oder Mäusen erreichen werden. Das wäre zwar noch immer kein Grund über die Einräumung von Maschinenrechten zu sprechen. Allerdings wird international ja ernsthaft darüber diskutiert, ob man Menschenaffen einen grundrechtsähnlichen Status zusprechen soll. Ich halte das nicht für abwegig. Und diese Diskussion ließe sich ganz analog auf Maschinen übertragen. Sie hat auch einen positiven Effekt. Denn sie erlaubt es, unsere Regeln der Zubilligung von Rechten kritisch zu hinterfragen. Die Perspektive auf Maschinen bietet eine verfremdete Perspektive, von der aus man sich fragen kann: Warum sprechen wir eigentlich Menschen Grundrechte zu? Manche meinen, selbst befruchtete Zellen hätten Menschenwürde und ein Recht auf Leben. Dann muss man auch darüber diskutieren dürfen, ob man sehr intelligenten Maschinen Rechte zuspricht.

Die Furche: Hängt das von der Komplexität ihrer Struktur ab? Von einem Bewusstsein? Von der Fähigkeit, autonom zu agieren?

Hilgendorf: In Bezug auf den Menschen würde ich diesen Zeitpunkt mit der Geburt identifizieren. Ich bin kein Anhänger der Ansicht, bereits befruchteten Zellen Menschenwürde zuzuschreiben. Das halte ich für eine Trivialisierung des Begriffs der Menschenwürde. Und derselbe Gedanke lässt mich auch zögern, von Maschinenrechten oder Maschinenwürde zu sprechen. Dazu müssten Maschinen schon sehr, sehr menschenähnlich sein und sich in ihrer Komplexität und Leistungsfähigkeit stark steigern, bevor wir ernsthaft anfangen können, darüber zu sprechen, dass sie Träger von Rechten oder Würde sind.

Die Furche: Damit machen Sie Rechtsfähigkeit von Maschinen also vom Grad der Menschenähnlichkeit abhängig?

Hilgendorf: Es ist eine anthropomorphe Perspektive, das gebe ich zu. Aber wir Menschen sind eben so. Wir erklären und ordnen die Welt aus unserer eigenen Perspektive heraus. Peter Singer hat das als Speziesismus bezeichnet. Ich hatte bei einem Workshop vor Kurzem eine interessante Diskussion über die Simulation von Schmerzempfinden einer Maschine. Wenn man bei einem Roboter oder autonomen System Schmerzen simuliert - ab wann hört die Simulation auf und echte Schmerzen beginnen? Und wie unterscheidet man das überhaupt? Wenn in der Maschine ein Zustand von Unwohlsein erzeugt wird, kann man darüber debattieren, ob das ethisch in Ordnung ist. Ich halte dieses Problem für außerordentlich spannend und wichtig, weil es hilft, unsere ethischen Intuitionen aus einer verfremdeten Perspektive zu hinterfragen. Was man da am Beispiel von Maschinen diskutiert, lässt sich sinnvoll auf Tiere anwenden. In der Ethik gibt es die Position, dass wir Tiere nicht deshalb schützen sollten, weil sie leiden. Sondern weil der Anblick schmerzerfüllter Tiere zu einer Verrohung des Menschen führt. Die gleiche Überlegung kann man in Bezug auf Maschinen anstellen, denen wir absichtlich so etwas wie Schmerz zufügen.

Die Furche: Man muss sich also nicht nur darüber Gedanken machen, Menschen vor Maschinen zu schützen - etwa wenn diese eine Fehlfunktion haben - sondern auch umgekehrt die Maschinen vor den Menschen schützen?

Hilgendorf: Das wäre denkbar. Man sollte sich aber vor unseriösen, zu stark an der Science-Fiction orientierten Szenarien hüten. In der Rechtswissenschaft ist das heute kein Thema. Und ich erwarte auch nicht, dass in den nächsten 20 Jahren jemand ernsthaft fordert, dass der Gesetzgeber Rechte für Maschinen einführt.

Die Furche: Welche rechtlichen Probleme ergeben sich aus der Robotik?

Hilgendorf: Das derzeit wichtigste Problem ist meines Erachtens der Datenschutz. Maschinen haben viele Sensoren, die unterschiedliche Daten aufzeichnen. Das ist auf die eine oder andere Weise problematisch. Das können personenbezogene Daten sein oder Arbeitnehmerdaten. Ein Sonderfall sind medizinische Daten. Eine andere Problemebene betrifft die zivilrechtliche Haftung auf Schadenersatz. Wenn ein automatisches Einparksystem kausal an einem Unfall beteiligt ist, kann man dann der Hersteller in Regress nehmen? Dazu gibt es noch ganz wenige Entscheidungen. Ich meine, dass es Sinn machen könnte, ab einer bestimmten Komplexität von autonomen Systemen eine Pflichtversicherung vorzusehen. Im Fall eines Fehlers oder Unfalls gibt es dann keine großen Auseinandersetzungen darüber, wer haftet. Man kann einfach auf die Vermögensmasse des autonomen Systems selbst zugreifen.

.png)