Künstliche Intelligenz im Alltag

Künstliche Intelligenz wird oft mystifiziert. Wieviel Künstliche Intelligenz steckt aber bereits tatsächlich in unserem Leben? Und was könnte die Zukunft bringen? Ermittlungen im Alltag.

Künstliche Intelligenz wird oft mystifiziert. Wieviel Künstliche Intelligenz steckt aber bereits tatsächlich in unserem Leben? Und was könnte die Zukunft bringen? Ermittlungen im Alltag.

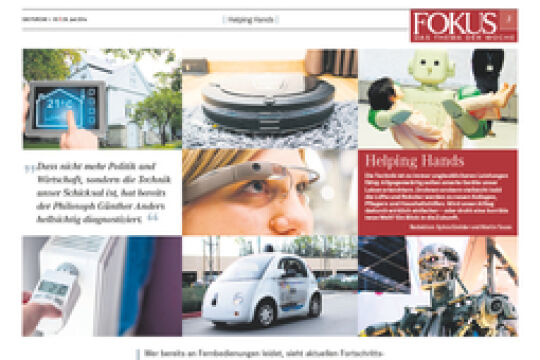

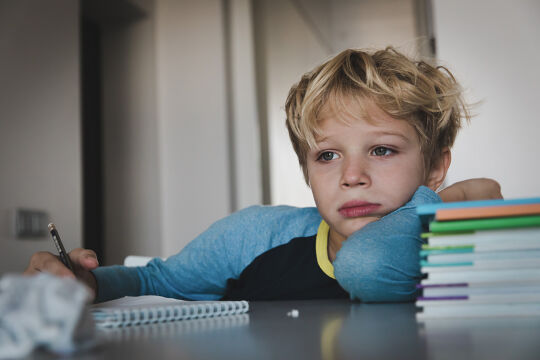

Kaum sichtbar schlängelt sich ein Faden am Gartenzaun meines Bruders entlang, als ob ein vorsichtiger Maulwurf ganz feine Linien gezogen hätte. Einige Meter Draht liegen hier vergraben, die dem Rasenroboter signalisieren: Hier ist der Garten zu Ende. Es ist Sonntagnachmittag. Unsere Eltern haben sich seinerzeit noch über die Erfindung der Akku-Heckenschere gefreut. Wir sitzen nun mit Kaffee und Smartphones auf der Terrasse und beobachten die Navigation des Rasenroboters auf dem Handybildschirm. Wie intelligent ist das?

Liebe Leserin, lieber Leser,

diesen Text stellen wir Ihnen kostenlos zur Verfügung. Im FURCHE‐Navigator finden Sie tausende Artikel zu mehreren Jahrzehnten Zeitgeschichte. Neugierig? Am schnellsten kommen Sie hier zu Ihrem Abo – gratis oder gerne auch bezahlt.

Herzlichen Dank, Ihre Doris Helmberger‐Fleckl (Chefredakteurin)

diesen Text stellen wir Ihnen kostenlos zur Verfügung. Im FURCHE‐Navigator finden Sie tausende Artikel zu mehreren Jahrzehnten Zeitgeschichte. Neugierig? Am schnellsten kommen Sie hier zu Ihrem Abo – gratis oder gerne auch bezahlt.

Herzlichen Dank, Ihre Doris Helmberger‐Fleckl (Chefredakteurin)

Assoziieren die einen mit KI, also Künstlicher Intelligenz, die unmittelbar bevorstehende Unterjochung des Menschen durch die Maschinen, sehen die anderen darin den Weg in eine bessere, endlich gerechte Gesellschaft. Aber was macht Künstliche Intelligenz eigentlich aus? Wo stehen wir heute? Wovor müssen wir uns wirklich fürchten? Und vor allem: Wie viel Künstliche Intelligenz steckt eigentlich schon in unserem Alltag?

Übermenschliche Leistungen

Eine Welt ohne Algorithmen ist heute eigentlich nicht mehr vorstellbar. Beinahe überall, wo große Mengen an Daten zu Verfügung stehen, kann Künstliche Intelligenz eingesetzt werden – und wird es bereits, ohne dass wir es bewusst wahrnehmen. Werbung im Internet würde uns ohne Algorithmen nie erreichen. Das Rechtschreibprogramm würde unsere Fehler nicht ausbessern. Das Navigationssystem würde unsere Ziele nicht berechnen können. Und wer ein Smartphone besitzt, hat seine KI eigentlich immer dabei: in Apps oder Messenger-Diensten. Die Ausmaße dessen versteht nur, wer aktiv versucht, KI im Alltag zu vermeiden. So wähle ich als Suchmaschine nicht an erster Stelle Google, sondern eine, die meine Privatsphäre respektiert: DuckDuckGo beispielsweise speichert keine IP-Adressen, protokolliert keine Nutzer-Daten und verwendet Cookies nur, wo sie absolut notwendig sind. Als Gegenleistung – treibt sie mich regelmäßig in den Wahnsinn. Sie schlägt mir Ergebnisse vor, die mich meistens nicht weiterbringen, mitunter auch noch in einer Sprache, die ich nicht spreche. Und wie ungeduldig war ich mit meinem neuen Diensthandy, bis es endlich das Wort FURCHE kennengelernt hat und mir die richtigen Textteile beim Hochladen von Social Media Postings vorgeschlagen hat!

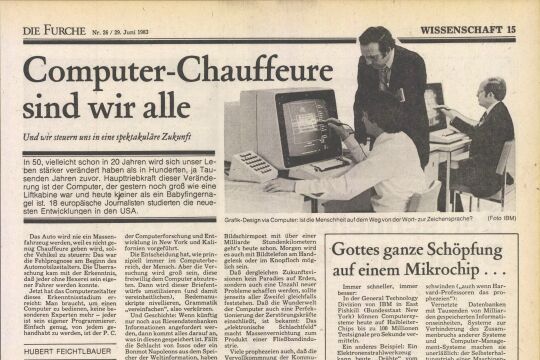

Was aber ist eigentlich Künstliche Intelligenz? Der Begriff „künstliche Intelligenz“ ist eigentlich irreführend, versucht man doch, im Grunde nur Maschinen beizubringen, Verhalten zu automatisieren und menschliches Lernen zu imitieren. Experten sprechen daher lieber von „Machine Learning“, andere wiederum bevorzugen den Begriff „erweiterte Intelligenz“. Welchen Begriff man auch immer wählt, beeindruckend sind die Computerleistungen allemal: Gelang es 1996 Deep Blue, einem von IBM entwickelter Schachcomputer, erstmals den damals amtierenden Schachweltmeister Garri Kasparow zu schlagen, schaffte es die KI AlphaZero 2017 von Google nach nur wenigen Stunden (!) selbstlernen, Schach auf einem übermenschlichen Niveau zu spielen. Magisch? Vielleicht. Vielleicht auch nicht: Ein Algorithmus ist doch nur ein Computercode, erzählt der YouTuber Cedric, den die Plattform mir automatisiert vorschlägt, nachdem ich zu Künstlicher Intelligenz bei Google recherchiert habe. Cedric nennt sich auf seinen Social Media Kanälen Dr. Watson, nach der von IBM entwickelten KI, die durch ihre erfolgreichen Auftritte in der Quizshow „Jeopardy!“ Berühmtheit erlangte.

Wie Maschinen lernen

Machine Learning, erklärt Cedric, beschreibt den Erwerb von Wissen durch ein künstliches System. Der Computer generiert selbstständig Wissen aus Erfahrungen und kann eigenständig Lösungen für neue und unbekannte Probleme finden. Dazu analysiert ein System Beispiele und versucht in den Daten bestimmte Muster und Gesetzmäßigkeiten zu erkennen. Vereinfacht gesagt: einzelne Neuronen, in ihrer Funktion inspiriert vom menschlichen Gehirn, bekommen ein Eingabesignal, bearbeiten es und liefern es aus. Füttert man so ein Netzwerk aus Neuronen beispielsweise mit Fotos von Gesichtern und Nicht-Gesichtern und bestätigt die richtigen Ergebnisse, so „lernt“ diese „künstliche Intelligenz“ die richtigen Ergebnisse, also Gesichter, auszuliefern. Machine Learning bedeutet also nichts anderes als Maschinen, die Daten „in

telligent“ miteinander verknüpfen, Zusammenhänge erkennen, Rückschlüsse ziehen und letztendlich Vorhersagen treffen.

Auf individueller Ebene erfüllen Algorithmen unsere Bedürfnisse auf diese Art schon längst, und schaffen uns Freiräume – Danke, Rasenroboter! Auch auf gesellschaftlicher Ebene sind diese KIs schon im Einsatz (siehe auch S. 5). Die Software COMPAS zum Beispiel errechnet für Richter die Rückfallwahrscheinlichkeit von Straftätern. „Fire Cast“ sagt der New Yorker Feuerwehr unter Einbeziehen verschiedener Daten voraus, welches Gebäude als nächstes brennen könnte. „Predict Policing“ in derselben Stadt schickt die Polizei dort auf Streife, wo vermutlich bald ein Verbrechen verübt wird. Auch die Zuteilung von Highschoolplätzen erfolgt in den USA schon algorithmusbasiert. Und in Österreich? Hier herrscht vor allem Skepsis: Der vom AMS eingesetzte Algorithmus, der arbeitslose Menschen in Kategorien von vermittelbar bis unvermittelbar einteilt, sorgte bei seiner Einführung für Aufregung.

Algorithmen erfüllen unsere Bedürfnisse schon längst und schaffen uns Freiräume - Danke, Rasenroboter!

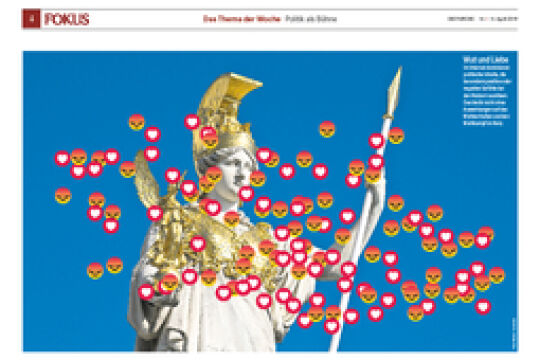

Lassen sich mit Algorithmen wirklich Verbrechen verhindern, bevor sie geschehen? Machen sie die Justiz fairer und das Bildungssystem gerechter? Jein. Jörg Dräger und Ralph Müller-Eiselt beschreiben in ihrem jüngst erschienenen Buch „Wir und die intelligenten Maschinen“ die Crux an den selbstlernenden Systemen: Sie funktionieren in Abhängigkeit von den Daten, mit denen sie gefüttert werden – und der Weltbilder jener, die sie füttern. Vorurteile inklusive. KI kann Diskriminierung und Benachteiligung auf einer technischen Ebene manifestieren.

Die Problematik sehen Peter Reichl (Cooperative Systems, Uni Wien), Christopher Frauenberger (Human Computer Interaction Group, TU Wien) und Michael Funk (Medien- und Technikphilosophie, Uni Wien), die als „Wiener Kreis zur Digitalen Anthropologie“ regelmäßig zum Philosophieren über Technik laden, vor allem in einer vermeintlichen Objektivität der Algorithmen. Wir geben ihnen damit einen höheren Wahrheitsgehalt. Zudem ist es schwierig, einer Software Fehlentscheidungen zu beweisen: Wenn ein Algorithmus mich als kreditunwürdig einstuft – wie kann ich je beweisen, dass ich meinen Kredit zurückgezahlt hätte?

„Schwache“ Künstliche Intelligenz ist in unserem Alltag längst angekommen, sie ist aber nur auf kleine Gebiete spezialisiert. „Starke“ KIs, die Schlussfolgerungen auf anderen Netzwerke übertragen, sind rein hypothetische Möglichkeiten. Superintelligente Maschinen mit eigenem Bewusstsein sind auch 2019 noch Science Fiction.

Die Grenzen der Algorithmen hinsichtlich Ethik und Moral müssen aber heute diskutiert werden – und werden auch in Zukunft immer neu ausgefochten werden müssen. Klar sind die Grenzen nur für den Rasenroboter: die Grenzen seines Gartens sind die Grenzen seiner Welt.

Wir und die intelligenten Maschinen

Von Jörg Dräger und Ralph Müller-Eiselt DVA 2019 272 Seiten, geb., € 20,60

Hat Ihnen dieser Artikel gefallen?

Mit einem Digital-Abo sichern Sie sich den Zugriff auf über 40.000 Artikel aus 20 Jahren Zeitgeschichte – und unterstützen gleichzeitig die FURCHE. Vielen Dank!

Mit einem Digital-Abo sichern Sie sich den Zugriff auf über 40.000 Artikel aus 20 Jahren Zeitgeschichte – und unterstützen gleichzeitig die FURCHE. Vielen Dank!