Eines der bekanntesten moralischen Gedankenexperimente ist das so genannte "Trolley-Problem": Eine Straßenbahn (engl. "trolley") ist außer Kontrolle geraten und droht, fünf Gleisarbeiter zu überrollen. Durch Umstellen einer Weiche kann die Straßenbahn auf ein anderes Gleis umgeleitet werden, doch unglücklicherweise befindet sich auch auf dieser Strecke ein Arbeiter. Würden Sie durch Umlegen der Weiche den Tod eines Menschen in Kauf nehmen, um dafür das Leben von fünf anderen zu retten?

Im konkreten Experiment sprachen sich 80 Prozent der Teilnehmer dafür aus, das Gleis zu wechseln, berichtete der Neuropsychologe Claus Lamm beim Biologicum Almtal, das von 4. bis 6. Oktober in Grünau stattgefunden hat (vgl. FURCHE Nr. 41/2018). Damit orientiert sich die große Mehrheit am Gesamtnutzen und somit an einem utilitaristischen Prinzip. Anders sieht die Sache aus, wenn es nur ein Gleis gibt und die fünf Arbeiter allein durch Herabstoßen eines Mannes von einer Brücke gerettet werden können, da dies der einzige Weg wäre, um den Zug zu stoppen. In diesem Fall würden nur 25 Prozent der Befragten den Mann von der Brücke stoßen.

Obwohl es hier jeweils darum geht, ob ein Mensch oder fünf Menschen durch einen Unfall getötet werden, fällt die Entscheidung in den zwei Situationen also ganz unterschiedlich aus. Woran liegt das? Neben anderen Ursachen könnte hier auch die stärkere Empathie für die weithin sichtbare Person auf der Brücke das moralische Handeln beeinflussen, so Lamm. Denn Empathie kann oft sehr einseitig ausgerichtet sein.

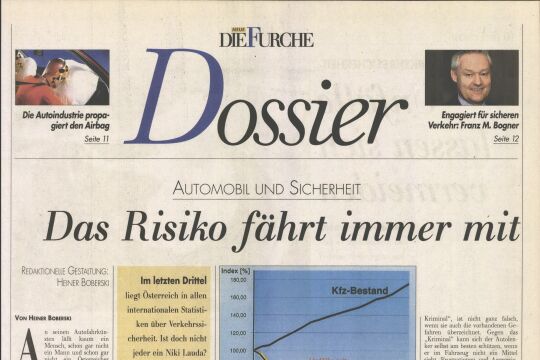

Errechnetes Crash-Risiko

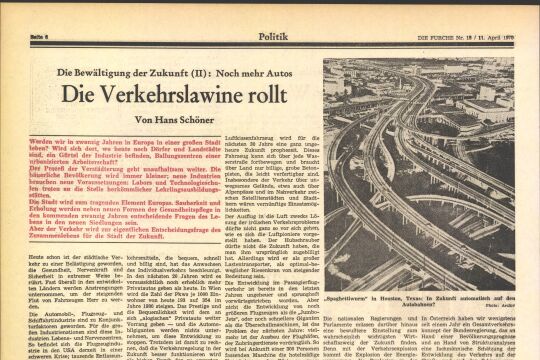

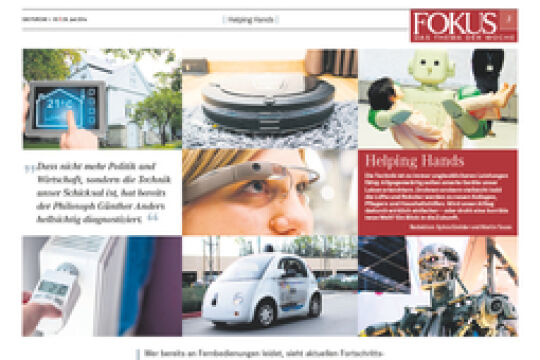

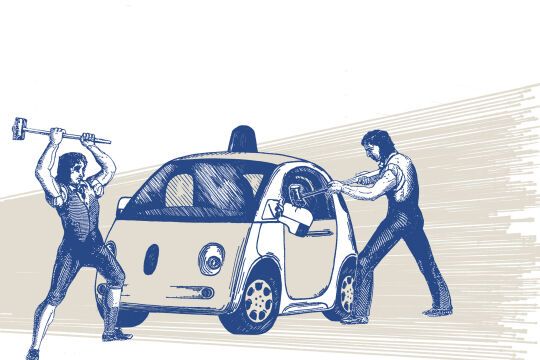

Das "Trolley-"und das "Brücken-Problem" sind klassische Beispiele für ein moralisches Dilemma -und nur ein kleiner Vorgeschmack dessen, was mit der Verbreitung selbstfahrender Autos auf Entwickler und Programmierer zukommen wird. Autonome Autos werden derzeit in fünf Klassen eingeteilt: Die unteren Stufen umfassen Fahrzeuge mit bereits gängigen Assistenzsystemen wie Tempomaten oder Einparkhilfen, bei den oberen geht es in Richtung Vollautomatisierung bis hin zu quasi selbständigen "Auto-Individuen". Komplett autonome Autos wie das "Google-Car" haben bereits erfolgreich Tausende Kilometer auf öffentlichen Straßen zurückgelegt.

Autonome Technologien sollen nicht nur die Fahrer entlasten, sondern auch Staus vermeiden und die Straßen sicherer machen. Dafür müssen sie andere Verkehrsteilnehmer frühzeitig erfassen. Mithilfe innovativer Sensorik etwa sollen künftig selbst kleine Hindernisse auch aus großer Distanz zu erkennen sein. Doch im März diesen Jahres hat im US-Bundesstaat Arizona ein tödlicher Unfall mit einem autonomen PKW für Ernüchterung und Erschütterung gesorgt: Eine Fußgängerin wurde auf einer Kreuzung von einem Fahrzeug des US-Fahrdienstvermittlers Uber erfasst, der seit 2016 selbstfahrende Autos im Testbetrieb hat.

Schwierige Entscheidungen gibt es zwar auch heute schon im Straßenverkehr. Doch mit der Entwicklung voll autonomer Fahrzeuge müssen diese im Voraus bedacht werden -und zwar systematisch anhand errechneter Wahrscheinlichkeiten. Denn es gilt, Algorithmen zu programmieren, die im Ernstfall schwerwiegende und verhängnisvolle Entscheidungen zu vollziehen haben. Wie soll sich das Auto verhalten, wenn es darum geht, das Leben der Autoinsassen gegen jenes der Fußgänger und der anderen Verkehrsteilnehmer abzuwägen? Und wie, wenn auf der einen Straßenspur eine schwangere Frau und auf der anderen Spur zwei ältere Männer zu Schaden kommen könnten (siehe auch Kasten unten)?

Ob ein selbstfahrendes Auto bei einer drohenden Kollision eine Notbremsung auf seiner Spur durchführen soll oder doch besser auf eine andere Spur ausweichen müsste, eruierte eine deutsche Studie, die kürzlich in der Fachzeitschrift Risk Analysis: An International Journal veröffentlicht wurde. Im einen Fall war ein Fußgänger auf der Straße gefährdet, im anderen ein Passant am Gehsteig. Das Unfallrisiko auf der Straße lag zwischen 20 und 80 Prozent. Am Gehsteig betrug das Risiko 50 Prozent oder es war unbekannt, weil die Systeme des Autos nicht in der Lage waren, die Wahrscheinlichkeit zu berechnen. Das Ergebnis zeigte ein klares Bild: Die Mehrheit der 872 Studienteilnehmer tendierte dazu, auf rückblickend bewertet wurde. 766 weitere Teilnehmer bestätigten hier das Ergebnis des ersten Experiments: Wenn das Auto auf der Spur geblieben war, machte es für die moralische Bewertung wenig Unterschied, ob es zu einem Unfall gekommen war oder nicht. Beim Ausweichmanöver hingegen sank die Akzeptanz dieses Verhaltens deutlich, wenn ein Crash stattgefunden hatte. Fazit: Selbst im Falle eines Unfalls war es akzeptabler, auf der gleichen Spur zu bleiben. Gemäß dem moralischen Empfinden wurde dieses Verhalten in kritischen Verkehrssituationen als Standardoption betrachtet - auch wenn dadurch zu erwartende Unfälle nicht verringert werden.

"Grauzonen der Ungewissheit"

Trotzdem stehen Entscheidungsträger vor der herkulischen Aufgabe, konträre Interessen unter einen Hut zu bringen. Denn viel hängt von der eigenen Perspektive ab, wie andere Studien zeigen: Außenstehende begrüßen autonome Autos, die im Ernstfall ihre eigenen Passagiere opfern, um die Gesamtzahl der Unfallopfer zu minimieren. Doch Autobesitzer neigen wenig überraschend dazu, ihre eigene Sicherheit stets an erster Stelle zu sehen. Und welcher Autohersteller würde schon dafür werben, die Sicherheit seiner Kunden zugunsten von anderen Verkehrsteilnehmern hintanzustellen?

"Es ist wichtig zu verstehen, wie Menschen über das Verhalten von selbstfahrenden Autos denken, wenn es Grauzonen der Ungewissheit gibt", sagte Björn Meder, ein Studienautor vom Max-Planck- Institut für Bildungsforschung. "Die Ergebnisse tragen dazu bei, die ethischen Implikationen des technischen Fortschritts zu beleuchten, der unsere Gesellschaft vielfältig verändern wird."

Ein Thema. Viele Standpunkte. Im FURCHE-Navigator weiterlesen.

In Kürze startet hier der FURCHE-Navigator.

Steigen Sie ein in die Diskurse der Vergangenheit und entdecken Sie das Wesentliche für die Gegenwart. Zu jedem Artikel finden Sie weitere Beiträge, die den Blickwinkel inhaltlich erweitern und historisch vertiefen. Dafür digitalisieren wir die FURCHE zurück bis zum Gründungsjahr 1945 - wir beginnen mit dem gesamten Content der letzten 20 Jahre Entdecken Sie hier in Kürze Texte von FURCHE-Autorinnen und -Autoren wie Friedrich Heer, Thomas Bernhard, Hilde Spiel, Kardinal König, Hubert Feichtlbauer, Elfriede Jelinek oder Josef Hader!